سوگیری اطلاعاتی ویکیپدیا پدیدهای است که کمکم از لابلای صفحات یک دانشنامهی عمومی به نیرویی تعیینکننده در شکلدهی به دانشِ دیجیتال تبدیل شده است. وقتی منابعی که میلیونها کاربر و الگوریتمهای یادگیری ماشینی به آنها تکیه میکنند، از زاویهای خاص روایت میکنند، نتیجه فقط یک اختلاف نظر آکادمیک نیست؛ این سوگیری مسیرِ آموزش مدلهای زبان بزرگ را هدایت میکند، فهم عمومی را قاببندی میکند و در نهایت معیارهای حقیقت را برای نسلهای بعدی فناوری تعیین میکند. در آن سوی ماجرا، ادعا به بیطرفی ویکیپدیا چالشبرانگیز میشود: آیا واقعاً مرجعیتی که وعدهی بیطرفی میدهد، توان مقابله با منافع شبکهای، منطق بازار و جهتگیریهای پنهان را دارد؟

این مقاله با نگاهی نقادانه و مستدل میکوشد نشان دهد چگونه “سوگیری اطلاعاتی ویکیپدیا” از لایهی تولید محتوا تا حلقههای آموزش هوش مصنوعی نفوذ میکند، چه خطراتی برای تنوعِ دیدگاهها و آزادی اندیشه پدید میآورد و چه راهکارهای ساختاری—از شفافسازی متدها تا راهحلهای غیرمتمرکز—برای این مسئله قابل تصورند. مطالعهی این متن به خواننده کمک میکند لایههای پنهانِ اعتبارسنجی منابع را بشناسد، پیامدهای عملی برای توسعهی مدلهای زبانی را درک کند و انتخابهایی آگاهانهتر برای حفظ تنوع اطلاعات و استقلال شناختی پیشنهاد دهد. با هامیا ژورنال تا با شواهد و تحلیلهایی که در پی خواهد آمد، تصویر کاملتری از این تهدید پنهان بدست آورید.

فهرست مطالب

روزنامه واشنگتن پست اخیراً گزارشی منتشر کرده است که در آن به علاقه دوباره جریانهای فکری متمایل به راست در ایالات متحده برای مشاهده توازن بیشتر و بیطرفی عمیقتر در محتوای مقالات ویکیپدیا اشاره شده است.

لری سنگر (Larry Sanger)، که یک سال پس از راهاندازی دانشنامه آنلاین در سال ۲۰۰۱، از سوی جیمی ویلز، یکی از بنیانگذاران، کنار گذاشته شد، همواره استدلال میکند که ویکیپدیا از تعهد اصلی خود به بیطرفی مطلق و دیدگاههای متعدد منحرف شده است. به باور وی، این سامانه دچار سوء مدیریت شده و در مواردی تمایل به افترا و بدنام کردن اشخاص دارد. او در پوشش موضوعات مناقشهبرانگیزی چون جرایم، مذهب، و تغییرات اقلیمی، جهتگیری متمایل به چپ مشاهده میکند که معتقد است با اصول بنیادین و آزادی اطلاعات در تضاد است.

انتقاد دیرینه سنگر با فشار کنشگران برجسته محافظهکار، به ویژه در کوران مباحثات سیاسی کنونی در ایالات متحده، جان تازهای گرفته است. این جریان، درصدد بازیابی نهادهای فرهنگی و منابع اطلاعاتی است که به زعم آنان، تحت تسلط و نفوذ جناح چپ قرار گرفتهاند. افرادی چون ایلان ماسک (Elon Musk – میلیاردر و کارآفرین شناختهشده)، تد کروز (Ted Cruz – سناتور جمهوریخواه ایالت تگزاس)، و تاکر کارلسون (Tucker Carlson – مفسر سیاسی مشهور) از جمله کسانی هستند که خواستار اصلاح بنیادین یا جایگزینی وبسایتی شدهاند که نهتنها به یکی از اصلیترین مراجع حقیقت مشترک در آن کشور تبدیل شده، بلکه شالوده اطلاعاتی برای سامانههای هوش مصنوعی را فراهم میسازد؛ هوش مصنوعیهایی که بهطور فزایندهای به مرجع پاسخگویی به جستوجوهای جهانی بدل شدهاند.

در تاریخ 3 اکتبر 2025، سناتور کروز نامهای سرگشاده به بنیاد ویکیمدیا (سازمان غیرانتفاعی مادر ویکیپدیا) ارسال کرد و خواستار پاسخگویی در مورد آنچه او آن را “سوگیری ایدئولوژیک” میخواند، شد. همچنین، در ماه آگوست، نمایندگان جمهوریخواه در کمیته نظارت مجلس نمایندگان تحقیقاتی را پیرامون احتمال دستکاری پلتفرم توسط آنچه آنان “بازیگران متخاصم دولتی” مینامند، آغاز کردند؛ بازیگرانی که هدفشان “قرار دادن مخاطبان غربی در معرض پیامهای طرفدار کرملین و ضد غربی” عنوان شد. در کنار اینها، ایلان ماسک در تاریخ 30 سپتامبر 2025، در X خود اعلام کرده است که قصد دارد در آینده نزدیک، جایگزین مبتنی بر هوش مصنوعی خود برای ویکیپدیا را تحت عنوان گروکیپدیا (Grokipedia) راهاندازی کند.

ویکیپدیا در رویارویی با هر موضوعی که واجد اهمیت سیاسی باشد، به صورتی کاملاً جانبدارانه و مغرضانه عمل میکند، و این وضعیت به خصوص در قبال مسائل مناقشهآمیز و حساسیتهای کنونی با وضوح تمام مشهود است. به عنوان مثال، در برخی پژوهشهای انتقادی، به فعالیتهای هماهنگ ویراستاران اشاره شده است که با هدفی مشخص، در تلاش برای بازنویسی و جهتدهی به مقالات مرتبط با اقتصاد مبتنی بر بازار آزاد و نقش دولت در توزیع منابع بودهاند. این رفتار استقلال اطلاعاتی را مخدوش میسازد.

این پویش سازمانیافته، که توسط تعدادی از ویراستاران با سابقه هدایت میشد، با هدف زیر سؤال بردن مزایای ساختار مبتنی بر بازار آزاد، توصیف مطلوب از نظریههای سوسیالیستی و مداخلهگرایانه دولتی، و معرفی دیدگاههای آکادمیک حاشیهای در مورد لزوم برنامهریزی مرکزی به عنوان نظرات جریان اصلی و معتبر، فعالیت میکرد. این اقدامات نشاندهنده تلاش نظاممند برای غلبه یک ایدئولوژی خاص بر محتوای دانشنامه است.

یکی از فعالترین ویراستاران این جریان، در مقالات تاریخی و مباحث پیچیده اقتصادی و اجتماعی، رویکردی ظریف و زیرکانه را در پیش گرفته که نشان از تلاشهای گستردهتری دارد. به عنوان نمونه، در مقالات مربوط به “مالکیت خصوصی”، حذف عبارات کلیدی درباره منشأ و اهمیت حقوق بنیادین مشاهده شده است. همچنین، تغییر شرح مختصر و ابتدایی مقالات به گونهای اعمال شده که ماهیت حقوقی قطعی برخی مفاهیم را زیر سؤال برده و آنها را صرفاً یک ساختار اجتماعی در حال تغییر معرفی میکند. این تغییرات، هرچند جزئی به نظر میرسند، اما در مفهوم ضمنی خود قابل توجه هستند.

همین ویراستار، در راستای تلطیف محتوای مقالات مربوط به سیاستهای مالیاتی سنگین، تلاشهایی را صورت داده است. برای مثال، اشاره به پیامدهای منفی نظامهای مالیاتی با نرخ بالا و آثار مخرب آن بر سرمایهگذاری خصوصی و بازار، از مقالات اصلی حذف شده است. افزون بر این، ذکر شواهد تاریخی مربوط به شکست برنامههای اقتصادی با دخالت دولتی وسیع، از تعدادی از مقالات مرتبط نیز حذف گردیده است. به طور کلی، حجم قابل توجهی از ویرایشها در حوزه موضوعی اقتصاد سیاسی و نقش دولت یا مقالات تاریخی مرتبط با این مباحث، توسط این گروه از ویراستاران اعمال شده است که جهتگیری محتوایی را تأیید میکند.

در مجموع، حجم قابل توجهی از ویرایشهای انجامشده توسط این جریان، بر مقالات مربوط به حوزه موضوعی اقتصاد سیاسی و نقش دولت یا مقالات تاریخی مرتبط با این مباحث متمرکز بوده است. این فعالیتها تأثیر گستردهای بر جهتگیری اطلاعاتی در این بخشها داشته است.

مسئله بنیادین ویکیپدیا صرفاً به ناشناس بودن ویراستاران یا عدم تخصص موضوعی آنها محدود نمیشود. چالش گستردهتر در این است که اتکای مطلق این سامانه به “منابع معتبر” به این معناست که عملاً تنها محتوای گزارششده توسط رسانههای متمایل به چپ یا جریانهای خاص فکری نظیر Mother Jones، CNN، Washington Post، و NY Times تکرار میشود و از در نظر گرفتن و استناد به مطالب منتشرشده توسط منابعی با گرایش متمایل به راست مانند NY Post یا Daily Mail به سادگی اغماض میشود.

سَنگِر مدعی است که اساس این سوگیریها در فهرستی نهفته است که توسط ویراستاران ویکیپدیا تدوین و نگهداری میشود و منابع اطلاعاتی رایج را بر اساس میزان قابلیت اعتماد و اعتبار عمومی، دستهبندی میکند.

همانگونه که سنگر نیز تأکید میکند، منابعی که در این فهرست “به طور کلی معتبر” قلمداد شدهاند، شامل سازمانهای رسانهای جریان اصلی و همچنین برخی نشریات متمایل به چپ مانند The Nation و Mother Jones میشوند. (لازم به ذکر است، اگرچه هر دوی این نشریات در ردیف منابع “به طور کلی معتبر” فهرست شدهاند، اما مدخلهای مربوطه به سوگیری چپ آنها اشاره کرده و از ویراستاران میخواهد که ادعاهای این منابع را صرفاً به منبع ارجاع دهند، نه اینکه آنها را مستقیماً به عنوان حقیقت مطلق بیان کنند.)

در سوی دیگر این طیف اعتبارسنجی، مواردی قرار دارند که ویکیپدیا آنها را “منابع منسوخشده (Deprecated Sources)” مینامد؛ منابعی که ویراستاران از استناد به آنها برای تأیید ادعاهای واقعی منع شدهاند. این دسته نه تنها رسانههای تحت کنترل دولت و سایتهای بدنام تبلیغاتی را در بر میگیرد، بلکه برخی از رسانههای خبری محبوب متمایل به راست همچون New York Post و Daily Mail را نیز شامل میشود. این رویکرد، آزادی دسترسی به طیف کامل اطلاعات را محدود میکند.

همانطور که سنگر در برنامه تاکر کارلسون (برای تماشای کامل این مصاحبه اینجا کلیک کنید) تصریح کرد، این استاندارد بدان معناست که اگر کارلسون به طور گسترده در رسانههای چپ مورد انتقاد قرار گیرد، اما تنها در رسانههای محافظهکار از او دفاع صورت پذیرد، “در آن صورت در مقاله [ویکیپدیا] هیچ دفاعی از شما لحاظ نخواهد شد و با وجود این نقص اطلاعاتی، آنها مقاله درباره شما را ‘بیطرف’ خواهند خواند.” این خود، نقض آشکار اصل جامعیت در گردآوری اطلاعات است.

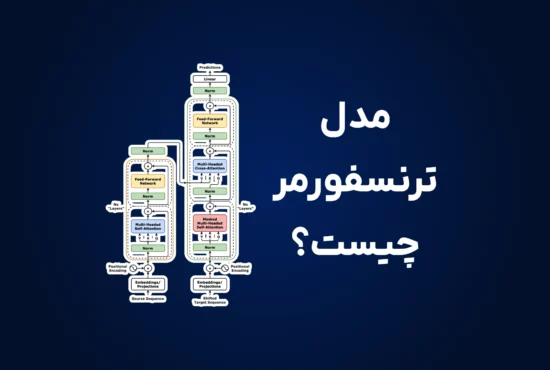

این وضعیت، دقیقاً شیوه عملکرد سیستم فعلی است و نتایج آن کاملاً قابل پیشبینی هستند. مقالات سیاسی به نوعی “تفکر گروهی متمایل به چپ” را منعکس میسازند و دیدگاههای مخالف را برنمیتابند. این معضل با این واقعیت تشدید میشود که اکنون از محتوای ویکیپدیا به عنوان دادههای آموزشی برای مجموعهای از مدلهای زبان بزرگ هوش مصنوعی (LLMs) استفاده میشود. بنابراین، این سوگیری محتوایی به لایه دیگری از ابزارهای شناختی نیز منتقل شده و در حال نهادینه شدن است.

مطالعه جدیدی که اخیراً توسط یک اندیشکده با رویکرد محافظهکارانه منتشر شد، اعتباری آکادمیک به گمانهزنیهای دیرینه فعالان سیاسی در خصوص وجود سوگیری در میان ویراستاران ویکیپدیا در تدوین مدخلهای مربوط به رویدادهای جاری بخشیده است.

بر اساس گزارش جدید مؤسسه منهتن(Manhattan Institute)، که اخیراً منتشر شد، مدخلهای ویکیپدیا مربوط به چهرهها و سازمانهای سیاسی محافظهکار، حاوی نگرشهای منفی و انتقادی بیشتری نسبت به مدخلهای مربوط به همتایان متمایل به چپ آنها هستند. به گفته دیوید روزادو (David Rozado)، نویسنده این تحقیق که یک دانشمند علوم کامپیوتر است و پیشتر نیز در مورد سوگیری آشکار چپگرایانه در چتبات ChatGPT و دیگر مدلهای زبان بزرگ پژوهش کرده بود، این جانبداری میتواند پیامدهای عمیقی برای آموزش و بیطرفی مدلهای زبان بزرگ هوش مصنوعی داشته باشد.

در گزارش روزادو آمده است: “به طور کلی، ما دریافتیم که مقالات ویکیپدیا تمایل دارند تا چهرههای عمومی متمایل به راست میانه را با احساساتی کمی منفیتر نسبت به چهرههای عمومی متمایل به چپ میانه مرتبط سازند؛ این روند را میتوان در اشارات به رؤسای جمهور ایالات متحده، قضات دیوان عالی، اعضای کنگره، فرمانداران ایالتی، رهبران کشورهای غربی، و روزنامهنگاران و سازمانهای رسانهای برجسته مستقر در ایالات متحده مشاهده کرد.”

همانگونه که پیشتر نیز استدلال شد، هوش مصنوعی حقیقتاً دانشی فراتر از آنچه از منابع اطلاعاتی دریافت کرده، ندارد. اگر تمام دادههای آموزشی آن در مورد مسائل حزبی و مناقشهبرانگیز، به دلیل اتکای مطلق به ویکیپدیا، جهتگیری متمایل به چپ داشته باشد، نتیجهای جز خروجی جانبدارانه نخواهیم داشت. این امر استقلال فکری و حق انتخاب کاربران را به خطر میاندازد.

بدین سان، اتکای بیقیدوشرط به محتوای ویکیپدیا به دلیل وجود سوگیری سیستماتیک و تمایل به نظرات متمایل به یک جریان خاص فکری در اعتبارسنجی منابع، نتایجی ناگزیر به همراه خواهد داشت. این رویکرد، در عمل دیدگاههای مخالف که بر آزادیهای فردی، بازارهای بدون تنظیمگری و محدودیت نقش دولت تأکید دارند، را به حاشیه میراند. هنگامی که مدلهای زبان بزرگ هوش مصنوعی (LLMs)، که به سرعت در حال تبدیل شدن به مرجع اصلی اطلاعات برای جوامع بشری هستند، بر پایه چنین دادههای جانبدارانهای آموزش داده میشوند، خروجی آنها نیز منعکسکننده همین جانبداری خواهد بود. این وضعیت، صرفاً یک نقص فنی نیست، بلکه یک محدودیت فکری سازمانیافته است که اصل تنوع دیدگاهها در بستر عمومی را نقض میکند.

این انتقال سوگیری از یک دانشنامه متمرکز به زیرساختهای شناختی هوش مصنوعی، پیامدهای عمیقی برای آزادی فردی و جامعهای که بر اصول آزادی بنا شده دارد. وقتی ابزارهای نوین آگاهی، مانند مدلهای هوش مصنوعی، ناخواسته تبلیغکننده دیدگاههای متمرکز، افزایش قدرت دولت و کنترل اقتصادی شوند، در واقع آزادی اندیشه را به شکلی نرم و نامحسوس محدود میسازند. این امر، امکان دستیابی آزادانه به طیف کاملی از اطلاعات و استدلالها را برای شهروندان از بین میبرد و عملاً به ترویج نوعی اجماع فکری هدایتشده میانجامد که مخالف با روحیه نقادی و فردگرایی عقلانی است.

اگر مبانی اطلاعاتی هوش مصنوعی، نظریههای دخالت دولتی وسیع را به عنوان واقعیتهای بدیهی معرفی کند و فلسفههایی چون عدم مداخله (Laissez-faire) یا اقتصاد بازار آزاد (Free Market) را به عنوان نظرات حاشیهای یا نامعتبر جلوه دهد، قضاوت مستقل کاربران دچار انحراف خواهد شد. در یک جامعه آزاد که بر رقابت ایدهها استوار است، محدودسازی دسترسی به دیدگاههای منتقد تمرکز قدرت، به مثابه سانسور غیرمستقیم عمل میکند. بنابراین، برای حفظ پویایی اجتماعی و حق انتخاب آگاهانه در جوامع بشری، ضروری است که اصول بیطرفی عمیقتر در منابع آموزشی مدلهای هوش مصنوعی لحاظ گردد تا تمامی دیدگاههای مهم، به ویژه آنهایی که بر استقلال فردی و حداقلی بودن دولت تأکید دارند، با اعتبار شایسته خود بازتاب یابند.

برای مقابله با چالش سوگیری در ویکیپدیا و انتقال آن به مدلهای زبان بزرگ (LLMs)، که تهدیدی جدی برای آزادی اطلاعات و جامعه آزاد است، باید بر رقابت آزاد و عدم تمرکز قدرت تأکید شود. راهکار اصلی نباید در تلاش برای اصلاح بوروکراسی متمرکز یک نهاد واحد خلاصه شود، چرا که هر منبع اطلاعاتی متمرکز نهایتاً در معرض تسخیر ایدئولوژیک قرار میگیرد. بلکه، باید به سمت ایجاد و ترویج رقبای متنوع و غیرمتمرکز حرکت کرد. این بدان معناست که سرمایهگذاری و حمایت از پروژههای دانشنامهای بدیل – مانند آنچه که با “گروکیپدیا” وعده داده شده است – که با فلسفههای ویرایشی متفاوت و استانداردهای اعتبارسنجی منابع متنوعتر فعالیت میکنند، یک ضرورت حیاتی است. رقابت در بازار اطلاعات، بهترین تضمین برای حفظ بیطرفی و تنوع دیدگاهها به شمار میرود.

علاوه بر رقابت در عرضه دانشنامه، باید به الگوریتمهای هوش مصنوعی نیز توجه شود. برای اجتناب از سانسور نرم در خروجیهای هوش مصنوعی، ضروری است که مدلها صرفاً بر یک منبع واحد تکیه نکنند. یک راهحل فناورانه، اجرای مکانیزمهای وزندهی شفاف است که به منابع فکری و رسانهای با جهتگیریهای متفاوت، اعتبار متناسب و عادلانه بدهد، حتی اگر در فهرستهای متمرکز، “منسوخشده” قلمداد شده باشند. این امر به مدلهای هوش مصنوعی اجازه میدهد تا یک تصویر کامل و سهبُعدی از مسائل مناقشهآمیز ارائه دهند. در نهایت، کاربران باید حق انتخاب شفاف داشته باشند که کدام منبع اطلاعاتی ورودی هوش مصنوعی خود را به رسمیت بشناسند و این شفافیت و حق انتخاب، بازار آزاد اندیشهها را تقویت میکند.

اصول فلسفه آزادی همواره بر اهمیت بینهایت فرد و آزادیهای عقلانی او تأکید دارند. در عصر هوش مصنوعی، این اصل به معنای آن است که هیچ نهاد متمرکزی – اعم از متصدیان دولتی یا بنیادهای بزرگ فناورانه – نباید کنترل انحصاری بر “حقیقت” و “دانش رسمی” داشته باشد. مقابله مؤثر با سوگیری ایدئولوژیک، در گرو غیرمتمرکزسازی فرآیند تولید و اعتبارسنجی اطلاعات است تا تفکر انتقادی فرد تضعیف نشود. با تضمین تعدد منابع اطلاعاتی و شفافیت در الگوریتمهای هوش مصنوعی، میتوان از تبدیل شدن فناوریهای نوین به ابزارهایی برای مهندسی اجتماعی و تحمیل یک ایدئولوژی واحد جلوگیری کرد و اصل آزادی اندیشه را پاس داشت.

سخن پایانی

در پایان، روشن است که سوگیری اطلاعاتی ویکیپدیا بیش از یک نقص فنی یا اختلاف نظری سطحی است؛ این سوگیری زنجیرهی انتقال دانش را از منبع تا مدلهای زبانی تغییر میدهد و بهطور مستقیم بر “چه چیزی” و “چگونه” بهعنوان حقیقت پذیرفته میشود تاثیر میگذارد. نکات کلیدیِ این مقاله را میتوان در چند گزارهی فشرده خلاصه کرد: ۱) ویکیپدیا بهعنوان یک مرجع عمومی میتواند حامل جانبداری ساختاری باشد؛ ۲) دادههای آموزشدهندهی هوش مصنوعی از این سوگیری متأثر میشوند؛ ۳) پیامدها شامل کاهش تنوع دیدگاهها و تغییر معیارهای اعتبار در فضای عمومی است؛ ۴) راهحلها باید ترکیبی از شفافسازی منابع، تنوعدهی به ورودیهای آموزش و اتخاذ سازوکارهای غیرمتمرکز برای توزیع قدرت اطلاعاتی باشد. این جمعبندی نشان میدهد که مواجهه با این چالش نیازمند هم توجه نظری و هم اقدام عملی است، نه صرفاً نقدِ محتوایی، بلکه بازطراحیِ سازوکارهای تولید و توزیع دانش.

اگر خواهان حفاظت از تنوع شناختی و ارتقاء شفافیت در زنجیرهی تولید دانش هستید، از شما دعوت میکنیم در خبرنامهی تخصصی هامیا ژورنال عضو شوید.

پرسشهای متداول

سوگیری اطلاعاتی ویکیپدیا به معنای وجود گرایشِ ساختاری یا محتوایی در مقالات است که نمایندهی دیدگاههای خاصی باشد و بتواند تصویر عمومی از یک موضوع را جهتدهی کند. اهمیت آن از این جهت است که ویکیپدیا بهعنوان منبعِ مرجع برای مردم و برای مجموعهدادههایی که در آموزش مدلهای هوش مصنوعی بهکار میروند، نقش تعیینکنندهای دارد.

بله؛ چندین مطالعه و گزارش علمی نشان دادهاند که در برخی مجموعهی مقالات، شیبهای ایدئولوژیک یا “slant” قابلتشخیصی وجود دارد و نتایج پژوهشها ناگفته نمیگذارند که سیاستِ بیطرفی (NPOV) همیشه به شکل کامل اجرا یا تضمین نمیشود. البته شدت و نوع این سوگیری بین زبانها و موضوعات متفاوت است.

بله. مدلهای زبانی هنگام آموزش از مجموعههای بزرگ متنی استفاده میکنند و اگر آن مجموعهها حامل سوگیری باشند، مدل میتواند آن سوگیریها را بازتولید یا تقویت کند؛ مطالعات و نقدهای اخیر این مسیرِ انتقال را هشدار دادهاند.

خواننده میتواند: (۱) همیشه منابع انتهای مقاله را بررسی کند، (۲) مطلب را در چند مرجع معتبر مقایسه کند، و (۳) به دنبال شاخصهایی مثل تنوع منابع، ارجاع به مطالعات اولیه و وجود دیدگاههای متضاد در متن باشد. این اقدامات ساده ریسکِ دریافت تصویرِ یکسویه را کاهش میدهد.

بله؛ راهکارهایی مثل وزندهیِ معتدل به منابع، پاکسازی و متادیتاسازی مجموعهدادهها، افزودن مجموعههای متنوعتر و کنترلهای ارزیابیِ خروجی مدل میتواند خطرات را کم کند. پژوهشها و مقالات فنی چند روشِ قابلاجرا را برای کاهش این ریسک پیشنهاد کردهاند.

اگر محتوای ما برایتان جذاب بود و چیزی از آن آموختید، لطفاً لحظهای وقت بگذارید و این چند خط را بخوانید:

ما گروهی کوچک و مستقل از دوستداران علم و فناوری هستیم که تنها با حمایتهای شما میتوانیم به راه خود ادامه دهیم. اگر محتوای ما را مفید یافتید و مایلید از ما حمایت کنید، سادهترین و مستقیمترین راه، کمک مالی از طریق لینک دونیت در پایین صفحه است.

اما اگر به هر دلیلی امکان حمایت مالی ندارید، همراهی شما به شکلهای دیگر هم برای ما ارزشمند است. با معرفی ما به دوستانتان، لایک، کامنت یا هر نوع تعامل دیگر، میتوانید در این مسیر کنار ما باشید و یاریمان کنید. ❤️